C’est quoi l’intelligence artificielle ? Deux mots qui fascinent, inquiètent, inspirent. Si vous êtes entrepreneur, dirigeant de PME ou étudiant en innovation, vous utilisez sûrement chaque jour plusieurs outils d’IA. Vous avez lu des articles, testé des outils, écouté des conférences. Mais à mesure que le domaine progresse, les termes changent, les usages se multiplient, les controverses s’accumulent. Tout va très vite et l’on finit par perdre le fil. Une remise à niveau s’impose. Ce cycle d’articles est conçu pour cela : vous accompagner, de manière structurée, de la découverte des fondamentaux jusqu’à la maîtrise de concepts avancés et d’usages concrets en entreprise. On commence par une question simple, presque évidente : c’est quoi, au juste, l’intelligence artificielle ?

- Dans cet article

-

Comprendre les fondements

- Une définition simple… et d’autres

- L’IA comprend-elle ce qu’elle fait ?

- Je dis « s’il te plaît » à ChatGPT, c’est grave ?

- IA faible vs IA forte : une distinction fondamentale

- Deux grandes approches : symbolique vs apprentissage

- C’est quoi l’intelligence artificielle ? Applications concrètes / Enjeux actuels

- Se projeter et agir

- Ce que vous pouvez faire concrètement pour progresser

- À retenir

- Testez vos connaissances

- Partager avec les autres innovateurs

- Ressources

Comprendre les fondements

Une définition simple… et d’autres

Dans son sens le plus large, l’intelligence artificielle (IA) désigne la capacité d’une machine à effectuer des tâches que l’on considère, en général, comme nécessitant de l’intelligence humaine : raisonner, apprendre, percevoir, comprendre le langage, prendre des décisions.

Mais cette définition a évolué avec le temps. Quelques repères :

- John McCarthy (1955) : « La science et l’ingénierie de la fabrication de machines intelligentes ».

- Marvin Minsky (1967) : « L’IA est la science qui rend les machines capables de faire des choses qui, si elles étaient faites par des humains, nécessiteraient de l’intelligence ».

- Patrick Winston (1992) : « « « L’IA est l’étude des calculs qui rendent possible la perception, le raisonnement et l’action ».

- Russell & Norvig (2021) : « L’IA est la construction d’agents capables de percevoir leur environnement et d’agir de manière à maximiser leurs chances de succès ».

En réalité, il n’y a pas UNE définition de l’IA, mais une constellation de tentatives pour cerner ce qui, fondamentalement, la distingue d’un simple programme informatique.

L’IA comprend-elle ce qu’elle fait ?

Cette question, en apparence anodine, est au cœur de débats scientifiques, philosophiques, techniques et même juridiques.

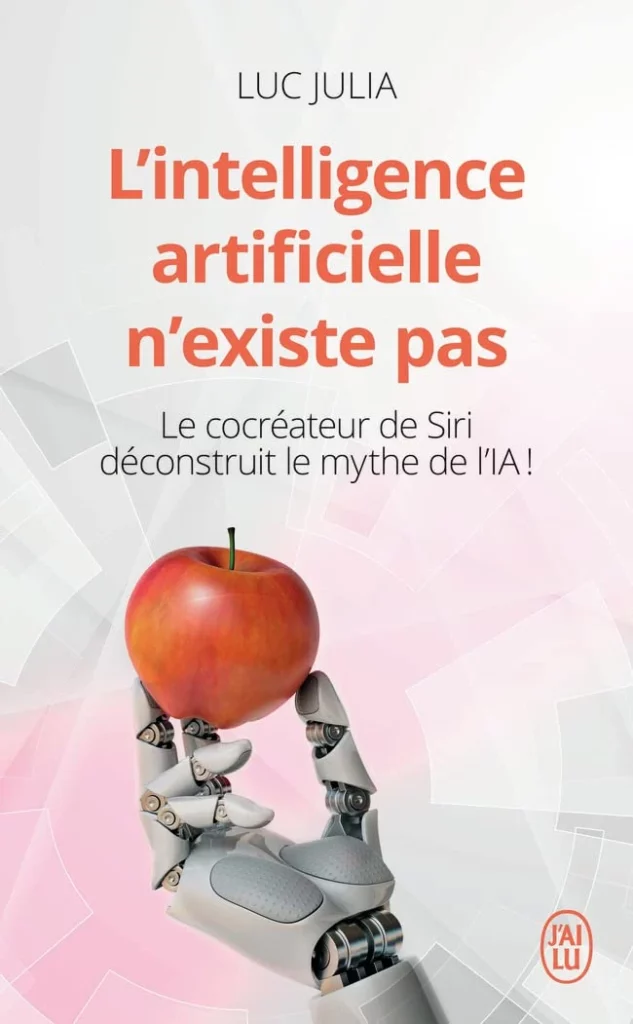

Aujourd’hui, les modèles d’IA les plus performants, comme les grands modèles de langage (GPT, Claude, Gemini, Mistral…), sont capables de répondre à une infinité de questions, d’écrire des poèmes, de coder, de résumer des textes complexes. Pourtant, ils n’ont aucune « compréhension » au sens humain du terme. Ils manipulent des symboles, sans intention, sans conscience, sans représentation interne du monde.

Le philosophe John Searle illustrait cela avec sa célèbre expérience de la chambre chinoise : une personne ne parlant pas chinois manipule des symboles à l’aide de règles pour produire des réponses qui semblent cohérentes pour un locuteur chinois. La personne ne comprend pas ce qu’elle fait, mais simule parfaitement la compréhension.

C’est exactement ce que fait une IA aujourd’hui. Elle prédit la suite la plus probable d’une chaîne de symboles, sans éprouver ni intention ni conscience.

Contrairement à un simple algorithme déterministe, l’IA — notamment les modèles de langage — ne suit pas un chemin rigide et prévisible. Si vous posez deux fois la même question à un outil comme ChatGPT, il pourra vous répondre de deux façons différentes. Non pas par caprice, mais parce que sa réponse est construite à partir de probabilités, de contexte, et d’un état interne dynamique. Il ne s’agit donc pas d’une suite d’instructions linéaires, mais d’un système complexe, dont le fonctionnement interne (poids, vecteurs, couches de neurones…) est difficilement interprétable. On parle alors de systèmes non déterministes ou boîtes noires : même leurs créateurs ne peuvent toujours expliquer pourquoi telle réponse a été générée à tel moment.

Je dis « s’il te plaît » à ChatGPT, c’est grave ?

Il est frappant de constater combien d’entre nous s’adressent à une IA comme à une personne. On remercie ChatGPT, on lui demande « s’il te plaît », on s’excuse parfois de poser une question trop compliquée. Ce réflexe, en apparence anodin, trahit une disposition profondément humaine : dès qu’un système nous répond avec fluidité, nous avons tendance à y projeter une forme d’intention, voire une conscience.

C’est ce qu’on appelle l’effet d’anthropomorphisme. Il ne s’agit pas seulement d’habillage marketing : c’est une réaction cognitive spontanée. Dès qu’un dialogue s’installe, même avec une machine, notre cerveau tend à reconnaître une forme d’altérité, un « tu » derrière les lignes de code. Ce phénomène pose une question redoutable : à partir de quand une machine devient-elle un interlocuteur ? Et faut-il poser une limite à cette illusion de relation ?

Les implications sont nombreuses : si l’on traite une IA comme une personne, faut-il la tenir responsable ? Peut-on lui déléguer un choix éthique ? Est-on manipulé quand on croit « discuter » alors que l’on n’échange qu’avec un automate statistique ? Ces questions ne sont pas théoriques : elles touchent à l’éducation, à la justice, au soin, à la gouvernance. Elles feront l’objet d’articles ultérieurs, mais elles s’enracinent dans ce geste simple : dire « merci » à un système qui ne ressent rien, mais qui parle comme nous.

Et demain ? Certains chercheurs explorent des voies vers une IA qui aurait un modèle interne du monde, une méta-cognition (savoir ce qu’elle sait), ou une représentation causale des phénomènes. Mais nous en sommes loin. Aucune IA actuelle ne comprend ce qu’elle fait comme un enfant de cinq ans le ferait.

IA faible vs IA forte : une distinction fondamentale

On distingue généralement deux types d’intelligences artificielles :

IA faible (ou étroite) : conçue pour accomplir une tâche spécifique (jouer aux échecs, traduire du texte, détecter des anomalies). Elle est efficace mais spécialisée, et n’a aucune forme de conscience ou de compréhension générale. IA forte (ou générale) : encore théorique à ce jour, elle serait capable de raisonner de manière autonome, de transférer des compétences d’un domaine à un autre, voire de prendre conscience d’elle-même. On parle parfois d’AGI (Artificial General Intelligence). Toutes les IA actuelles sont des IA faibles, même les plus impressionnantes comme ChatGPT ou Claude.

Et demain ? Certains chercheurs explorent des voies vers une IA qui aurait un modèle interne du monde, une méta-cognition (savoir ce qu’elle sait), ou une représentation causale des phénomènes. Mais nous en sommes loin. Aucune IA actuelle ne comprend ce qu’elle fait comme un enfant de cinq ans le ferait.

Deux grandes approches : symbolique vs apprentissage

Historiquement, l’IA a été explorée via deux grandes voies :

- L’IA symbolique (ou « GOFAI » : Good Old-Fashioned AI) repose sur des règles logiques, des représentations explicites, des arbres de décision. Elle excelle dans les systèmes experts, le raisonnement déductif ou la planification.

- L’IA par apprentissage (machine learning, deep learning) repose, elle, sur l’analyse de grandes quantités de données pour ajuster automatiquement ses propres modèles internes. Elle domine aujourd’hui la recherche, en particulier pour la reconnaissance d’images, le traitement du langage, etc.

Ces deux approches peuvent parfois être hybrides. Le débat reste ouvert sur laquelle permettrait un jour d’atteindre une forme d’intelligence « forte ».

C’est quoi l’intelligence artificielle ? Applications concrètes / Enjeux actuels

Où trouve-t-on de l’IA dans notre quotidien ?

Dans la plupart des cas, l’IA est déjà à l’œuvre dans des tâches que nous ne remarquons même plus :

- les suggestions de recherche sur Google,

- les recommandations sur Netflix ou Deezer,

- les filtres anti-spam dans nos boîtes mail,

- la reconnaissance faciale pour déverrouiller un smartphone,

- la navigation dans Waze ou Google Maps,

- le classement automatique des photos,

- les assistants vocaux comme Alexa ou Siri.

Il ne s’agit pas ici d’IA « générales », mais d’IA spécialisées, discrètes, optimisées pour une tâche.

En entreprise : gain de temps, de précision, de valeur

Pour les entreprises, l’IA peut jouer plusieurs rôles :

- Amélioration de la productivité : automatisation de tâches simples (lecture de mails, tri de documents, transcription de réunions).

- Optimisation de la relation client : chatbots, réponses automatiques, segmentation comportementale.

- Prédiction et décision : analyse des ventes, maintenance prédictive, modélisation de scénarios.

- Création de contenu : marketing, design, textes juridiques, scripts vidéo.

Les limites actuelles

Mais l’IA reste imparfaite. Elle hallucine1, se trompe, reproduit les biais des données d’entraînement. Elle est gourmande en énergie et en données. Elle peut être opaque, difficile à auditer, voire manipulable.

Il ne faut donc pas la mythifier, mais l’intégrer lucidement.

Se projeter et agir

Débuter simplement

Pas besoin de recruter une armée de data scientists pour tirer profit de l’IA. De nombreux outils no-code ou low-code permettent de tester des cas d’usage :

- Notion AI pour générer du contenu structurant

- ChatGPT pour brainstormer, rédiger, résumer

- Zapier + OpenAI pour automatiser des processus

- Synthesia pour créer des vidéos explicatives

L’important est de cibler une problématique claire, pas d’acheter une solution miracle.

Poser un cadre responsable

Dés le départ, pensez à l’éthique, à la sécurité des données, à la transparence des outils utilisés.

- Où vont les données ?

- Peut-on expliquer les résultats ?

- Qui valide les sorties ?

- Quelle gouvernance mettre en place ?

Un usage mûr de l’IA commence par des questions simples mais essentielles.

Ce que vous pouvez faire concrètement pour progresser

Quelques pistes simples pour explorer l’IA dès aujourd’hui, même sans bagage technique :

- Tester un chatbot IA : essayez ChatGPT (https://chatgpt.com), Poe (https://poe.com), ou bien-sûr le français Mistral via le site de Le Chat (https://chat.mistral.ai/chat) pour prendre la mesure de leurs capacités (et de leurs limites). Commencez par les versions gratuites qui présentent la plupart des fonctionnalités intéressantes.

- Observer les IA à l’œuvre dans vos outils quotidiens : Gmail, Notion, Zoom ou même Word intègrent des briques IA. Explorez leurs options « intelligentes ».

- Installer un outil local : si vous êtes curieux, testez GPT4All ou LM Studio pour faire tourner un modèle IA sur votre ordinateur personnel.

- Commencer un carnet d’observation : notez à chaque fois qu’une IA intervient dans votre journée. Cela rendra visible l’invisible.

- Lire et écouter des ressources fiables : commencez par les deux premier épisodes du podcast de la Cité de l’IA (Les Carnets de l’IA). Au programme : les témoignages de deux experts incontournables dans l’écosystème IA.

- Vincent Béhague : « comment initier un projet d’IA dans mon entreprise

- Mathieu Clément-Ziza « l’IA au service de la R&D »

Le plus dur, c’est de s’y mettre. Le reste vient tout seul.

À retenir

- L’IA n’est pas magique : elle repose sur des statistiques et des données.

- Il n’existe pas une IA mais des formes très variées, adaptées à des usages spécifiques.

- Les modèles génératifs actuels sont puissants mais ne comprennent rien.

- L’IA est déjà partout autour de vous, souvent sans que vous le sachiez.

- L’intégrer dans votre entreprise peut se faire progressivement, sans équipe R&D.

- Commencez par un besoin concret, testez, mesurez.

- Pensez dès le début à l’impact éthique et à la sécurité des données.

Testez vos connaissances

[ays_quiz id=’1′]

Partager avec les autres innovateurs

[bbp-derniers flux=reponses forum_id=85520 nombre=8 lien=non titre=oui extrait=oui taille_extrait=100]

Pour poster un message dans les forums, vous devez être identifié comme membre ou lecteur des Cahiers de l’Innovation.

Ressources

- C’est quoi une hallucination pour une IA ? Il s’agit d’une réponse fausse ou trompeuse qui est présentée comme un fait certain; par exemple, un chatbot qui génère un chiffre d’affaires pour une entreprise sans avoir de données à ce sujet. C’est franchement très déroutant au début. ↩︎